资讯列表

世界模型再进化!DrivingWorld:通过视频GPT构建自动驾驶世界模型(港科技&地平线)

写在前面 & 笔者的个人理解最近自回归(AR)生成模型的成功,如自然语言处理中的GPT系列,促使人们努力在视觉任务中复制这一成功。 一些工作试图通过构建能够生成逼真的未来视频序列和预测自车状态的基于视频的世界模型,将这种方法扩展到自动驾驶。 然而,先前的工作往往产生不令人满意的结果,因为经典的GPT框架旨在处理1D上下文信息,如文本,并且缺乏对视频生成所必需的空间和时间动态进行建模的固有能力。

1/2/2025 9:12:34 AM

Xiaotao Hu等

伦敦大学学院、华盛顿大学研究:AI 写作工具正不断进步,但仍无法媲美人类创造力

研究发现,人类在诗歌、小说和演讲领域的表现明显优于 AI,分别高出 80%、100% 和 150%。

1/2/2025 9:07:14 AM

清源

多模态RAG技术:从语义抽取到VLM应用与规模化挑战

一、基于语义抽取的多模态 RAG多模态 RAG 的发展方向旨在构建一个高度集成的系统,能够无缝融合文本、图像和其它多媒体元素,为用户提供更丰富的信息交互体验。 实现多模态 RAG 系统的三种主要技术路径如下:传统对象识别与解析(雕花路线)传统的多模态文档处理首先会运用图像识别技术,如 OCR(Optical Character Recognition,光学字符识别),从图像中抽取出文字、表格和图片等元素。 之后,这些独立的对象会被进一步解析,转换成文本格式,以便于后续的信息检索与分析。

1/2/2025 8:36:25 AM

金海

Switch 2 发布之际,任天堂“机器学习超分”专利公开

专利示例显示,假设某款游戏原生支持 4K 纹理,可能需要60GB的存储空间,而1080p版本仅需20GB,从而可以装入目前最大容量为32GB的 Switch 游戏卡带。在设备端,游戏将实时进行4倍分辨率升级。

1/2/2025 7:42:39 AM

清源

本科学历但创造出GPT,奥特曼盛赞为「爱因斯坦级」天才,OpenAI总裁:他想要的,我们都给

奥特曼称他是爱因斯坦级别的天才;OpenAI总裁更是直言:只要他想要的,我们都给。 Alec Radford大神离职OpenAI,现在牵出更多细节:改变世界的GPT,竟然是在Jupyter notebook上诞生的。 而他只负责提供背后的灵感,剩下的由工程师来解决。

1/2/2025 7:30:00 AM

英伟达 2024 年豪掷 10 亿美元,为 AI 初创公司提供资金支持

英伟达在刚刚过去的2024年向人工智能初创企业投入了10亿美元(当前约 73.16 亿元人民币)资金,成为推动 AI 革命的重要支持者,而这场革命正是由其芯片技术驱动的。

1/2/2025 7:19:23 AM

清源

1080P高清视频十秒生成!广告创意秒出片,支持动漫风,国产玩家出品

马上就要2025了,没想到国产AI视频模型PixVerse又给咱们整了一波新活! 继上次席卷全网的万物皆可毒液之后,它们又火速更新了3.5版本。 新模型不仅能10秒光速生成高清视频,而且复杂运动、各种二次元风格也都轻松拿捏——△提示:尼克和朱迪(《疯狂动物城》)在森林里一起骑车这次他们还内置了更多有趣的模版:成为肌肉猛男、圣诞礼物盲盒等等,非常适合快速生成短视频。

1/2/2025 7:10:00 AM

没有博士学位却开启了GPT时代,奥特曼盛赞Alec Radford,爱因斯坦级天才

《连线》曾在一篇报道中将 Alec Radford 在 OpenAI 扮演的角色,比作 Larry Page 发明 PageRank。 PageRank 彻底革新了互联网搜索方式,Radford 的工作(特别是在 Transformer 和后来的 GPT 方面的研究)从根本上改变了 AI 语言模型的工作方式。 几天前,OpenAI 宣布组织结构调整,裂变成了一家营利性公司和一个非营利组织。

1/2/2025 7:05:00 AM

上交大揭露大模型审稿风险:一句话就能让论文评分飞升

大语言模型(LLMs)正以前所未有的方式,深刻影响着学术同行评审的格局。 同行评审作为科学研究的基石,其重要性毋庸置疑。 然而,随着大语言模型逐渐渗透到这一核心过程,我们是否已经准备好面对它可能带来的深远影响?

1/2/2025 7:00:00 AM

尹同跃:把 AI 定义为改变奇瑞未来命运的重要机遇和突破口

奇瑞控股董事长尹同跃昨日发布 2025 年新年献词,其中提到,把 AI 定义为改变奇瑞未来命运的重要机遇和突破口。

1/1/2025 6:34:23 PM

汪淼

百度增设搜索产品:上线“AI 搜”,通过 @与不同智能体交互

百度“AI 搜”是基于百度文心大模型打造的桌面端 AI 搜索引擎,目前内容侧已经打通百度搜索引擎、百度健康、百度律临、百度文库、百度教育等内容生态。

1/1/2025 1:34:48 PM

文猛

2024 年另类 AI 评测标准走红:“威尔・史密斯吃意大利面”领衔

随着人工智能视频生成技术的不断发展,一个有趣的现象开始在业内流行:当一家公司发布全新的人工智能视频生成器时,似乎总有人会第一时间用它来制作威尔・史密斯吃意大利面的视频。这不仅演变成了一种网络热梗,更成为衡量新型 AI 视频生成器性能的非官方基准 —— 检验其能否逼真地呈现史密斯狼吞虎咽吃面的场景。史密斯本人也在去年二月通过 Instagram 发布了一段模仿视频,亲自参与了这场网络狂欢。

1/1/2025 12:17:19 PM

远洋

2025 年考研数学一得 126 分,智谱深度推理模型 GLM-Zero 预览版上线

GLM-Zero-Preview 是 GLM 家族中专注于增强 AI 推理能力的模型,擅长处理数理逻辑、代码和需要深度推理的复杂问题。

12/31/2024 5:53:12 PM

沛霖(实习)

拓元智慧完成近亿元人民币Pre-A轮融资

作者 | 赖文昕编辑 | 陈彩娴近日,拓元智慧(X-Era AI)宣布成功完成 Pre-A 轮融资,融资金额接近一亿人民币。 此轮融资由粤科金融集团、鹏城愿景基金、红鸟启航基金等投资机构共同参与。 早在 2022 年 12 月,拓元智慧就已获得银杏谷资本、源数投资、卓源资本和汉仁资本投资的数千万元天使及天使 轮融资。

12/31/2024 5:27:00 PM

赖文昕

AI时代 技术性失业会愈演愈烈吗

此前的技术性失业只不过是暂时的、局部性的问题。 但我们不能认为从过去历史中获得的经验可以原封不动地套用于未来的状况。 过去与未来的前提不同,走向当然也会不同。

12/31/2024 4:08:40 PM

天涯咫尺TGH

ScienceAl 2024「AI+药物&医疗&基因组&细胞」专题年度回顾

编辑 | 白菜叶2024 年,药物、医疗、基因组学和细胞生物学领域迎来了前所未有的技术突破与创新。 从 AI 驱动的药物设计到基因编辑的精准控制,从单细胞分析到多模态医疗决策,这一年见证了科学与技术的深度融合,为人类健康带来了无限可能。 在药物研发领域,AI 驱动的分子设计与优化方法不断涌现,显著提升了新药发现的效率与精准度。

12/31/2024 3:43:00 PM

ScienceAI

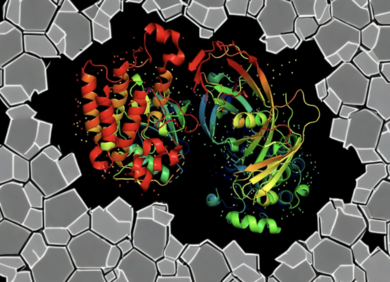

Science子刊,斯坦福AI方法表示蛋白互作节点,增强功能识别与PPI推理

编辑 | 白菜叶生物网络通过详细描绘基因、蛋白质及其他细胞成分之间的复杂相互作用,为建模生物系统提供了重要工具。 这些网络将实体表示为节点,将其相互作用(从物理连接到功能关联)表示为边,从而为解析生物系统和过程的复杂性奠定了基础。 例如,在蛋白质-蛋白质相互作用(PPI)网络中,复杂的连接关系包含了理解细胞过程和疾病机制的关键信息。

12/31/2024 3:42:00 PM

ScienceAI

线性化注意力综述:突破Softmax二次复杂度瓶颈的高效计算方案

大型语言模型在各个领域都展现出了卓越的性能,但其核心组件之一——softmax注意力机制在计算资源消耗方面存在显著局限性。 本文将深入探讨如何通过替代方案实现线性时间复杂度,从而突破这一计算瓶颈。 注意力机制基础理论本文假设读者已经熟悉ChatGPT、Claude等模型及其底层的transformer架构原理。

12/31/2024 3:34:00 PM

Shitanshu Bhushan