由波士顿Graylark Technologies开发的GeoSpy是一款强大的AI工具,可通过分析图像中的建筑风格、植被类型以及建筑物之间的空间关系等特征,在几秒钟内高精度定位照片的拍摄位置。这项技术引起了公众和执法机构的广泛关注,其市场定位为执法部门、威胁情报公司和政府机构提供服务。

GeoSpy经过数百万张全球图片训练,能够识别“显著的地理标志”,如特定的建筑样式、土壤特征及其空间排列关系。虽然其强项在美国,但官方表示该工具具有全球范围的定位能力。

应用场景广泛

GeoSpy的功能已经在多个实际案例中得到验证。例如:

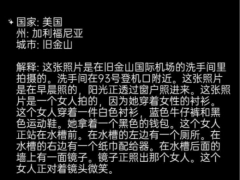

- 犯罪调查:GeoSpy可以通过分析建筑物和街道特征,成功将一段视频定位到旧金山的具体位置。

- 自然灾害评估:在分析洛杉矶附近的火灾照片时,GeoSpy虽然未完全准确,但能够提供关于地形、建筑类型和海岸线的有用线索。

- 威胁情报:GeoSpy被用于定位乌克兰战区坦克的移动轨迹,为军事行动提供支持。

- 欺诈检测:用户可通过GeoSpy核实房源图片是否位于广告所述城市,从而识别虚假房源。

GeoSpy甚至可以从移除了EXIF元数据的图片中提取地理信息,通过仅依赖图像内部特征进行定位。这种能力突破了传统方法的限制,使得追踪匿名照片变得更加容易。

工具开放引发争议

尽管GeoSpy的技术受到称赞,但其开放性和滥用风险引发了巨大争议。

在GeoSpy最初的公共测试版中,有用户利用工具追踪他人位置,甚至试图定位某些YouTube创作者的家庭地址。一些用户在Discord社区中发布“可疑请求”,例如定位“朋友”的工作地点或某女性的住所。这些行为引发了伦理问题,也成为公众批评的焦点。

GeoSpy的广泛应用让传统隐私保护手段(如删除元数据)失效。Electronic Frontier Foundation(EFF)高级安全研究员库珀·昆廷(Cooper Quintin)警告称,这种工具可能被用来大规模收集地理信息,甚至可能导致执法机构误用或误判,带来不必要的恐慌和错误逮捕。

在受到外界批评后,GeoSpy关闭了免费公共版本,目前仅向“执法机构、企业用户和政府实体”提供访问权限。然而,根据创始人丹尼尔·海宁(Daniel Heinen)在Discord上的消息,执法版本的GeoSpy功能更加强大,能够针对特定区域进行地理围栏,并生成详细的威胁情报。

潜在的安全与法律问题

GeoSpy提供了大规模分析图片的能力,但其准确性并非完全可靠。例如,某些情况下的定位结果并不精确,可能误导执法行动。如果这种工具被用来分析非犯罪嫌疑人的照片,可能侵犯公民隐私权,并导致无辜者受到不公正对待。

EFF指出,GeoSpy的存在提醒人们需要重新思考威胁建模,将包括地理定位AI工具在内的新技术纳入隐私保护策略。例如,针对高风险人群的隐私保护需更加全面。

海宁本人也承认,GeoSpy可能被用来进行恶意追踪或非法监视。尽管他在社区中主动关闭某些不当请求,但技术本身的开放性让这些行为难以完全杜绝。