亚历山大・王牵头,消息称 Meta 明年将推出全新图像视频与文本 AI 模型

AI在线 12 月 21 日消息,据《华尔街日报》报道,Meta 公司正全员动员,在由 Scale AI 联合创始人亚历山大・王(Alexandr Wang)牵头的超级智能实验室中研发新一代人工智能模型。 目前,该公司正在推进两个新项目:一个代号为“芒果(Mango)”的图像与视频模型,以及一个内部名为“牛油果(Avocado)”的全新文本模型。 AI在线注意到,该媒体援引 Meta 于周四举行的内部问答会内容称,这家科技巨头计划在 2026 年上半年推出这些新模型。

12/21/2025 11:09:05 AM

远洋

知名 AI 科学家杨立昆创办新公司 AMI,拟募资 5 亿欧元开发世界模型 AI

AI在线 12 月 21 日消息,知名人工智能科学家杨立昆(Yann LeCun)于周四证实,他已创办一家新初创企业(这是科技圈公开的秘密)。 不过他表示,自己不会担任新公司的首席执行官。 这家初创公司名为先进机器智能公司(Advanced Machine Intelligence, 简称 AMI),并已聘请医疗转录人工智能明星初创企业 Nabla 的联合创始人兼首席执行官亚历克斯・勒布伦(Alex LeBrun)出任其首席执行官。

12/21/2025 10:55:21 AM

远洋

中国移动联合华为、中兴推出业界首个网络原生 AI 话音降噪能力,主观评测效果达中高端手机水平

AI在线 12 月 21 日消息,中国移动研究院、中国移动河南公司近日联合华为、中兴正式推出业界首个网络原生 AI 话音降噪能力,通过将“高精度、低时延”的 AI 降噪模型以轻量化插件形式部署至话音网络,实现降噪能力的即插即用与快速上线。 据中国移动研究院介绍,当前,用户在机场、地铁、商场等嘈杂环境中通话时,常因背景噪声干扰而影响沟通效率。 尽管部分终端已具备端侧降噪能力,但此类能力依赖终端自身算力与算法,难以覆盖所有用户。

12/21/2025 10:49:43 AM

归泷

可玩转千余款游戏,英伟达联合斯坦福等研发 NitroGen 开源模型

AI在线 12 月 21 日消息,一支由英伟达、斯坦福大学、加州理工学院等机构的研究人员组成的多元化团队,研发出了一款名为 NitroGen 的模型。 英伟达人工智能总监、杰出科学家吉姆・范于周五在领英发文称,NitroGen 是“一款经训练可玩转 1000 余款游戏的开源基础模型”。 但该模型的意义远不止于此,其影响力从游戏领域延伸至现实世界,能为仿真技术和机器人学带来可观的价值。

12/21/2025 10:35:18 AM

远洋

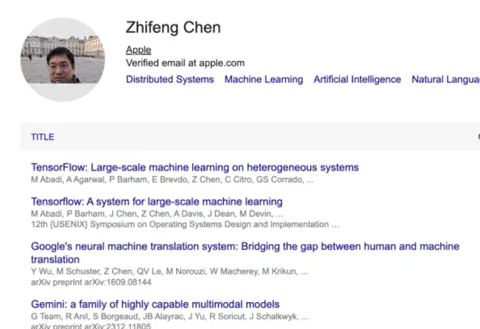

库克提拔复旦校友掌舵苹果基础模型!庞若鸣走后涨薪止血,谷歌旧部占据半壁江山

衡宇 发自 凹非寺. 量子位 | 公众号 QbitAI. 庞若鸣被扎克伯格天价挖去Meta后,谁在执掌苹果大模型团队?

12/21/2025 10:29:03 AM

衡宇

研究发现:若告知消费者广告是由 AI 生成的,点击率会减少 31%

AI在线 12 月 21 日消息,纽约大学与埃默里大学的研究人员开展的一项新研究显示,人工智能营销的效果存在显著差异:完全由人工智能生成的广告能大幅提升点击率,而仅用人工智能对人工创作内容做微调的尝试却收效甚微。 尤为值得注意的是,若标注广告为“人工智能生成”,其营销效果会骤然下降。 据AI在线了解,该研究结果凸显出两种广告制作方式的巨大差距:由人工智能从零开始构建的广告,表现远优于那些仅用生成式人工智能对人工设计成品做编辑修改的广告。

12/21/2025 8:51:06 AM

远洋

纽约出台 AI 安全法案:要求大企业公示安全协议,违规最高罚 300 万美元

AI在线 12 月 21 日消息,美国纽约州州长凯西・霍楚尔已签署《RAISE 法案》,纽约由此成为美国第二个出台重磅人工智能安全法案的州。 该法案于今年 6 月经州议会通过,但在科技行业游说后,霍楚尔曾提议修改法案以降低其管控力度。 据《纽约时报》报道,霍楚尔最终同意签署原版法案,同时州议员们承诺将于明年落实她提出的修订意见。

12/21/2025 8:33:01 AM

远洋

上手即用!2025年AI产品信任设计指南

编者按:传统的 APP 要建立信任机制并不复杂,现在有很多值得参考的模式、范例。 但是 AI 类产品所面临的情况是截然不同的,那么如何为 AI 类产品进行信任设计呢? 今天来自 Mary Borysova 的这篇文章就基于这个视角,结合一系列的头部 AI APP 来和你一起探讨这个问题。

12/21/2025 2:01:12 AM

Mary Borysova

LeCun的JEPA已进化为视觉-语言模型,1.6B参数比肩72B Qwen-VL

LeCun 的联合嵌入预测架构(JEPA)迎来了新进展。 近日,来自 Meta、香港科技大学、索邦大学、纽约大学的一个联合团队基于 JEPA 打造了一个视觉-语言模型:VL-JEPA。 据作者 Pascale Fung 介绍,VL-JEPA 是第一个基于联合嵌入预测架构,能够实时执行通用领域视觉-语言任务的非生成模型。

12/21/2025 1:11:00 AM

机器之心

人人都是导演:CineCtrl首个实现视频生成中的相机运镜与摄影效果统一控制

仅凭一段普通视频,能否像专业导演一样,在后期随意改变相机轨迹,同时精细调整变焦、光圈散景、曝光度甚至图像色温? 现有视频生成模型往往难以兼顾「运镜」与「摄影美学」的精确控制。 为此,华中科技大学、南洋理工大学、商汤科技和上海人工智能实验室团队推出了 CineCtrl。

12/21/2025 1:06:00 AM

机器之心

玩到崩溃,《青椒模拟器》游戏爆火,我在AI世界一路升级做院士

「出门在外,身份都是自己给的」。 最近两天,一款名为《青椒模拟器》的小游戏突然火了,好玩程度一整个把人震撼住了。 游戏时间以学年为单位推进。

12/21/2025 1:00:00 AM

机器之心

布局控制+身份一致:浙大提出ContextGen,实现布局锚定多实例生成新SOTA

随着扩散模型(Diffusion Models)的迭代演进,图像生成已经日臻成熟。 然而,在 多实例图像生成(Multi-Instance Image Generation, MIG) 这一有着大量用户场景的关键领域,现有的方法仍面临核心瓶颈:如何同时实现对多个对象的空间布局控制(Layout Control)以及身份特征的良好保持(Identity Preservation)。 主流方法往往无法做到两全其美:依赖文本和布局引导(Layout-to-Image)的模型往往难以实现高度的实例定制化,且实例遗漏、属性泄露的问题时有发生;而主流的主体驱动(Subject-driven)方法在主体数量增加时,面临着严重的身份混淆和细节丢失的问题。

12/21/2025 12:54:00 AM

机器之心

Anthropic公布新技术:不靠删数据,参数隔离移除AI危险

近年来,大语言模型的能力突飞猛进,但随之而来的却是愈发棘手的双重用途风险(dual-use risks)。 当模型在海量公开互联网数据中学习时,它不仅掌握语言与推理能力,也不可避免地接触到 CBRN(化学、生物、放射、核)危险制造、软件漏洞利用等高敏感度、潜在危险的知识领域。 为此,研究者通常会在后训练加入拒答机制等安全措施,希望阻断这些能力的滥用。

12/21/2025 12:48:00 AM

机器之心

欧洲刑警组织最新设想:2035 年有可能爆发“机器人犯罪潮”

AI在线 12 月 20 日消息,当地时间 12 月 19 日,据外媒 The Verge 报道,欧洲刑警组织最新报告指出,AI 和机器人技术的迅猛发展,未来既可能强化执法能力,也可能成为犯罪分子的武器。 报告由欧洲刑警组织创新实验室发布、共 48 页,并非严格预测,而是一次面向 2035 年的前瞻性推演。 报告描绘的未来世界中,智能机器广泛存在于家庭、医院、工厂,以及警局、商店和学校等公共空间。

12/20/2025 8:10:28 PM

清源

AI 人才争夺战白热化,谷歌另辟蹊径“返聘”老员工

AI在线 12 月 20 日消息,在 OpenAI、Meta 和 Anthropic 之间的人才竞争不断加剧之际,谷歌选择通过大规模“回聘老员工”来参与这场 AI 人才争夺战。 当地时间 12 月 19 日,CNBC 报道称,谷歌在 2025 年新招募的 AI 相关软件工程师中,约五分之一为曾经离职又回归的员工,这一比例高于此前几年。 谷歌方面确认,截至 12 月这一比例仍然成立,同时指出,与 2024 年相比,来自主要竞争对手的 AI 研究人员数量明显增加。

12/20/2025 7:56:01 PM

清源

气象人工智能模型“风源”雄安首发,直接读取卫星、雷达、气象站等数据

AI在线 12 月 20 日消息,中国气象局 12 月 19 日宣布气象 AI 家族又添一名“硬核”新成员 ——“风源”v1.0 气象人工智能科学模型在雄安首发。 同时,2024 年发布的气象人工智能模型“风清”“风雷”“风顺”完成了技术升级。 AI在线从官方介绍获悉,如果说此前的气象人工智能预报模型善于学习,需要依赖气象数值预报模式分析的数据,来学习并预测未来天气。

12/20/2025 7:44:19 PM

浩渺

小岛秀夫:我不会用生成式 AI 创作视觉内容,但用于游戏控制系统也不错

AI在线 12 月 20 日消息,在拉瑞安工作室确认在《神界》开发流程中引入生成式 AI 之后,AI 在游戏开发中的应用再次成为行业讨论的焦点。 当地时间 12 月 19 日,据外媒 Wccftech 报道,在这股讨论热潮中,小岛秀夫近日也在采访中谈到了自己对生成式 AI 的看法。 ▲ 小岛秀夫,图源:小岛工作室官网小岛秀夫坦言:“与其让 AI 生成视觉内容之类的东西,我更感兴趣的是把 AI 用在游戏的控制系统上。

12/20/2025 6:00:46 PM

清源

Meta 首席 AI 官汪滔:如果你现在 13 岁,就该把所有精力都放在氛围编程上

AI在线 12 月 20 日消息,当地时间 12 月 19 日,据《财富》杂志报道,Meta 首席 AI 官、 28 岁“天才少年”汪滔(Alexandr Wang)给正在步入初中的 Alpha 世代提出了建议 —— 忘掉游戏、运动或传统的课后兴趣。 “如果你现在大概 13 岁,就应该把所有时间都用在氛围编程上,这就该是你的生活方式。 ”在汪滔看来,原因很简单:包括自己在内,工程师正在写下的代码可能在五年内全部过时。

12/20/2025 5:39:07 PM

清源

资讯热榜

标签云

AI

人工智能

OpenAI

AIGC

模型

ChatGPT

谷歌

DeepSeek

AI绘画

大模型

机器人

数据

AI新词

Midjourney

开源

Meta

微软

智能

用户

GPT

学习

智能体

技术

Gemini

马斯克

英伟达

Anthropic

图像

AI创作

训练

LLM

论文

代码

算法

苹果

AI for Science

腾讯

Agent

Claude

芯片

Stable Diffusion

具身智能

蛋白质

xAI

开发者

生成式

人形机器人

神经网络

机器学习

3D

AI视频

RAG

大语言模型

Sora

研究

百度

生成

GPU

字节跳动

工具

华为

AGI

计算

大型语言模型

AI设计

搜索

生成式AI

视频生成

亚马逊

DeepMind

AI模型

特斯拉

场景

深度学习

Transformer

架构

MCP

Copilot

编程

视觉