OpenAI 公司昨日(3 月 21 日)发布博文,联合 MIT Media Lab,分享了首份关于使用 ChatGPT 如何影响人们情绪健康的研究。

研究发现,用户与 AI 的互动方式、个人情感需求以及使用时长等因素,均会影响其情感状态。研究通过大规模数据分析与随机对照试验,揭示了 AI 情感使用的复杂性和局限性,为未来 AI 平台的负责任开发提供了重要参考。

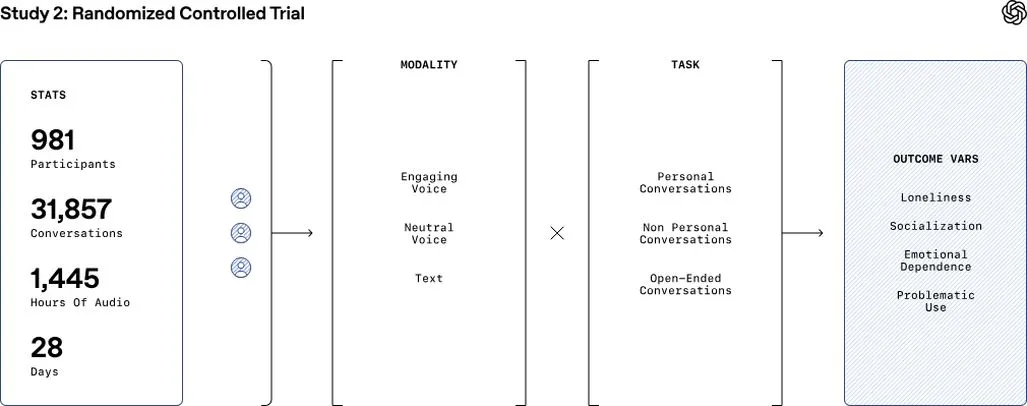

OpenAI 在调查过程中,一方面分析了近 4000 万次 ChatGPT 互动,结合用户调查,了解真实使用模式;另一方面联合 MIT Media Lab 团队招募近 1000 名参与者,进行为期四周的 ChatGPT 使用实验,探讨平台功能和使用类型对用户心理状态的影响。

AI在线援引博文介绍,附上相关发现如下:

情感互动较少:大多数 ChatGPT 对话中并未出现情感互动,表明情感使用并非主流。

重度用户的情感依赖:少数重度用户(尤其是高级语音模式用户)更倾向于将 ChatGPT 视为“朋友”,并表现出较高的情感依赖。

语音模式的影响:语音模式在短期使用中可能提升用户幸福感,但长期使用则可能带来负面影响。

对话类型的影响:个人对话(如表达情感)可能增加孤独感,但减少情感依赖;非个人对话(如讨论工作)则可能增加情感依赖。

个人因素的影响:用户的情感需求、对 AI 的认知以及使用时长,均显著影响其情感健康。