1. 前言

在短视频与图文内容井喷的今天,创作者面临信息过载、二创合规性困境及多平台适配壁垒。跨平台爆款内容分散于不同生态,人工搬运低效且素材利用率不足20%。直接搬运面临限流风险,而人工改写效率低下,难以平衡原创度与爆款基因。此外,不同平台风格差异导致传统工作流繁琐,创作成本增加。为此,我基于Coze+DeepSeek双引擎,开发了一款跨平台智能二创工作流,通过智能解析技术一键打通数据闭环,深度融合语义理解实现多维度二创优化,并通过飞书多维表格沉淀知识资产,帮助创作者高效生成内容,提升原创度并转化热点为可复用方法论。

2. Coze工作流设计

本工作流旨在一键识别抖音分享链接、小红书网页链接或公众号文章网页链接,提取链接中的文案内容,并进行文案的二次创作,最后将结果写入飞书表格。通过这一流程,创作者可以高效地获取和再利用社交媒体上的信息。

3. 工作流创建

接下来我将介绍一下工作流创建过程中的一些核心节点。

开始节点: 开始节点主要输入参数为url,支持抖音分享链接、小红书链接、公众号文章链接。

识别链接( 大模型 节点): 给大模型一个提示词将抖音、小红书或公众号的原始链接识别出来

用户提示词为:

复制识别{{input}}中的链接.

如果内容中只有链接。直接输出链接。

# 限制

- 只输出网址链接

- 不做任何修饰说明。

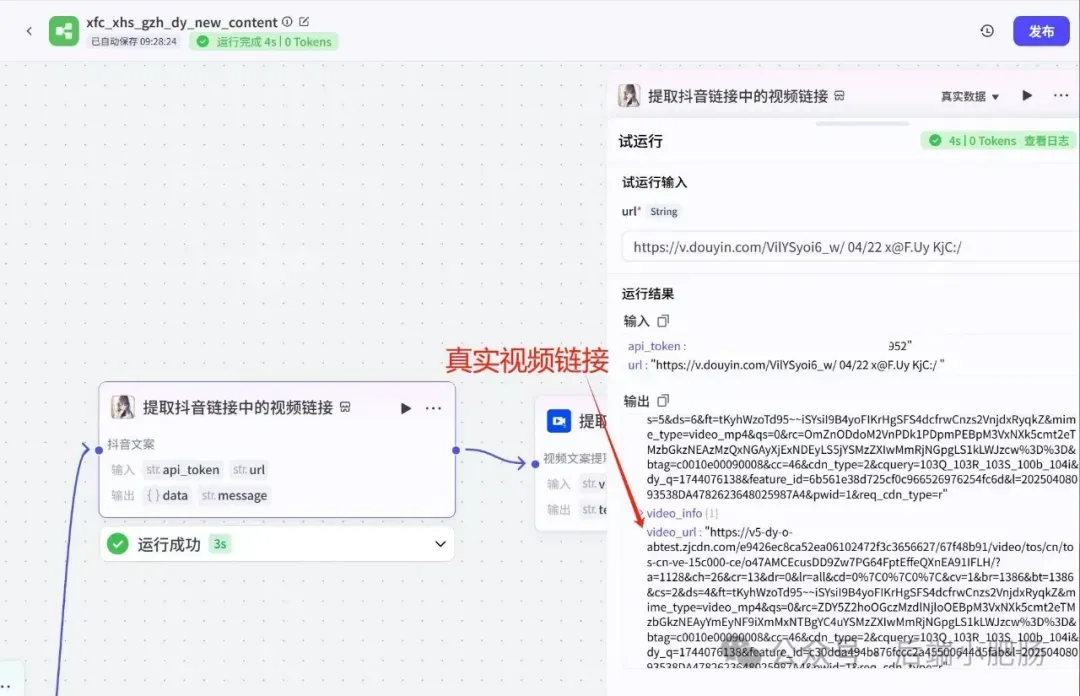

- 只输出一个网址链接。提取抖音链接中的视频链接(付费插件): 提取抖音链接中的真实视频链接。

提取视频(插件,有免费额度,想流畅使用也要付费): 根据真实视频链接提取视频中的文案。

爆改抖音/公众号/小红书文案( 大模型 ): 这个节点就是根据上一个节点提取出来的文案进行爆改二创,我用的豆包Pro模型,因为平台不同,针对三个平台我用了三种提示词,想要提示词的朋友可以跳转至第四章。

识别公众号/小红书(插件): 这个插件可以根据小红书或公众号的网页链接来提取网页中文章的内容。

把内容调整为 飞书表格 适配内容( 大模型 ): 这个节点的作用就是把之前工作流处理的内容整合为飞书表格适配的内容,我用的豆包Pro大模型。

系统提示词:

复制输出:[{"fields":{"原文链接": "{{link}}","原文内容": "{{content}}","二创内容":{{new_content}},"平台":{{platform}}}}],不要做任何解释我解释一下这个提示词,这个提示词中fields对应的是飞书表格字段:

写入 飞书表格 : 这个节点的作用是把相关内容添加到飞书表格中,app_token为飞书表格的链接地址,records为上一个节点——把内容调整为飞书表格适配内容( 大模型 ) 的输出内容。

结束: 反馈工作流运行结果。

4. 效果演示

点击试运行,输入小红书链接,records为1代表写入成功:

去飞书表格里面查看结果,可以看到原文链接、原文内容、平台和二创内容均被添加到了飞书表格中:

上面的提示词只是模板,实际使用还要基于DeepSeek进行二创调整,不会二创的可以看我这篇文章:RAG回答准确率暴涨300%!用Coze工作流进行数据结构化(附完整提示词)