编辑 | ScienceAI

图(Graphs)是描述复杂关系和结构化数据的重要工具,从分子设计到社交网络分析,它们在许多领域都扮演着关键角色。然而,图生成的高效性与灵活性一直是一个挑战。

今天,我们向大家介绍一项突破性的研究——Graph Generative Pre-trained Transformer,简称 G2PT,一个重新定义图生成和表示方式的自回归模型。

这项工作由塔夫茨大学、东北大学和康奈尔大学的研究团队合作完成,研究团队充分借鉴了大语言模型(Large Language Models/LLMs)的最新进展,为图生成带来了全新的解决方案。🚀

Sequence Tokenization实现高效生成

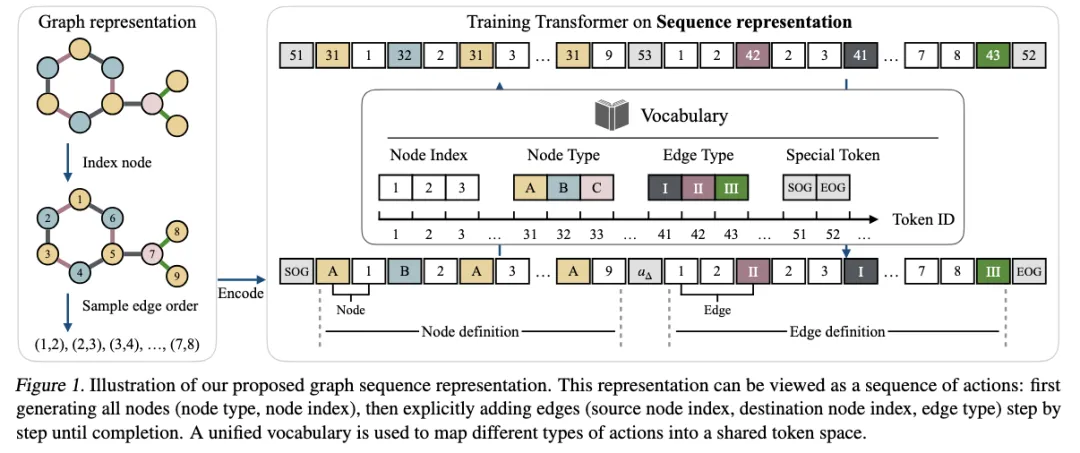

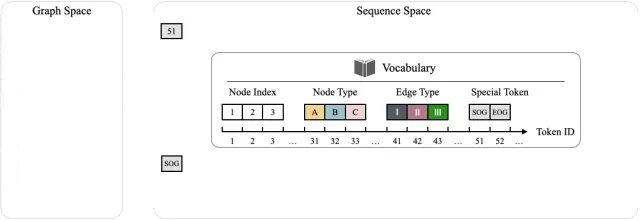

传统的图生成模型大多依赖邻接矩阵(adjacency matrix)进行表示,这种稠密的表示方式计算成本高、内存占用大。G2PT 提出了基于序列的 tokenization 方法,通过将图分解为节点集(node set)和边集(edge set),充分利用图的稀疏性,从而大幅提升计算效率。

这一创新性的分词方式使得大型预训练 Tranformer 可以像处理自然语言一样逐步生成图,并通过预测下一个 token 的方式完成整个图的生成。

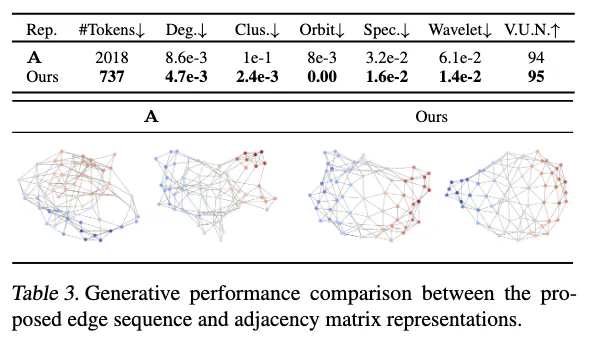

📊 图序列表示方式示意图如下(来自论文 Figure 1):

这一方法不仅减少了 token 数量,还显著提升了生成质量。

📽 动态展示:G2PT 的序列生成过程

通过上图,我们可以直观地看到 G2PT 如何从节点生成开始,逐步定义边的连接关系,最终完成整个图的生成过程。这种序列化的表示不仅有效减少了数据规模,还能充分利用 Tranformer 架构在序列建模上的优势。

同时,论文中 Table 3 比较了基于同样的GPT模型用传统邻接矩阵表示(A)和序列表示(Ours)在 Planar Graph 上的生成性能,结果显示 G2PT 的序列表示在多项指标上优于邻接矩阵方法。

G2PT 的适应性和扩展性

G2PT 是一个具备多样适应能力的通用图生成模型。通过 Fine-tuning 技术,它在以下任务中表现出色:

目标导向图生成

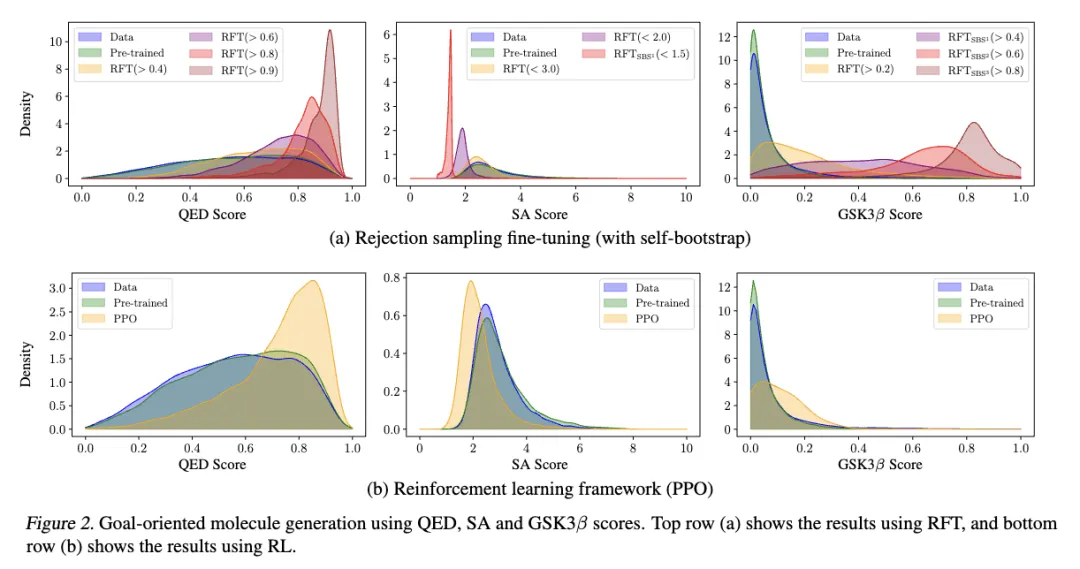

G2PT 利用拒绝采样微调(Rejection Sampling Fine-tuning, RFT)和强化学习(Proximal Policy Optimization, PPO)技术生成特定属性的图,例如在药物设计中优化分子图的理化性质。

📈 结果展示(来自论文 Figure 2):

在目标导向生成任务中,G2PT 能显著将分布偏移至目标属性区域。

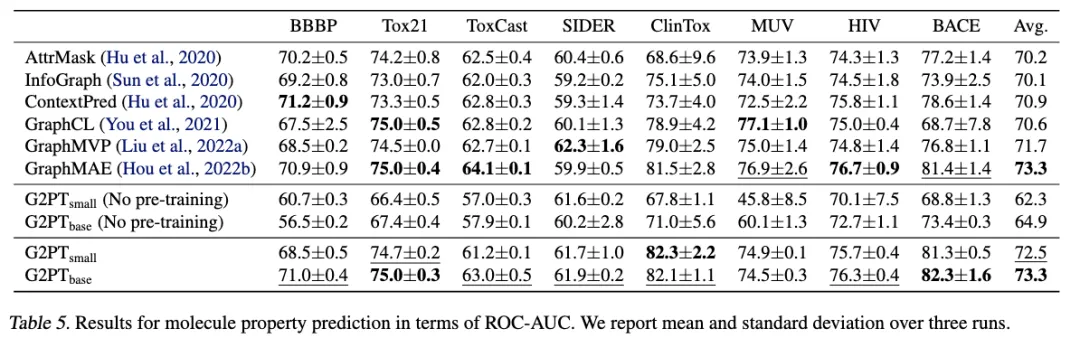

图属性预测

通过提取预训练模型的图嵌入,G2PT 在下游任务中同样表现卓越。在 8 个分子属性预测数据集上的 ROC-AUC 分数(见 Table 5)显示,G2PT 达到了与当前最先进方法相媲美的性能。

通用和分子图生成的全面超越

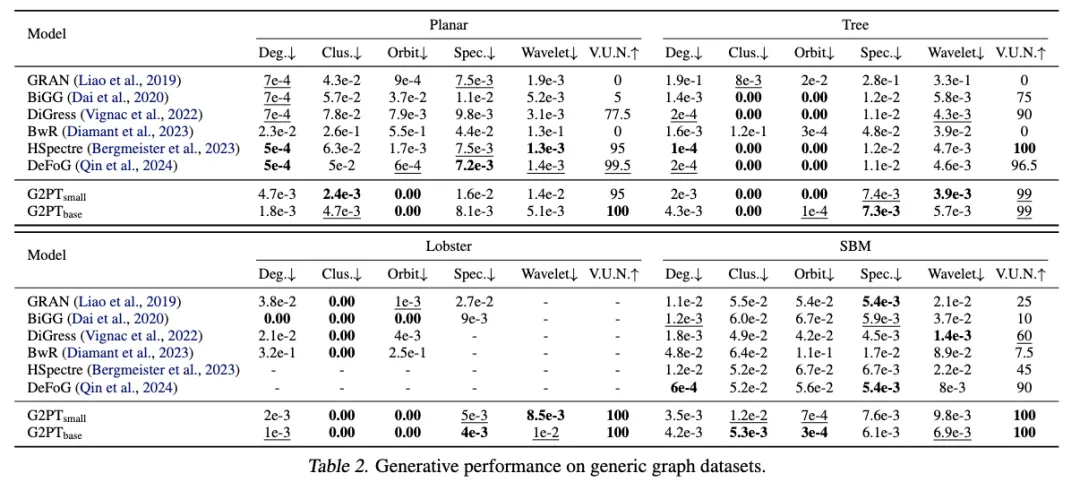

在多个基准数据集上的对比实验表明,G2PT 的表现显著优于或匹配现有的最先进模型。

通用图生成性能

📊 Table 2 中展示了 G2PT 在 Planar、Tree、Lobster 和 SBM 数据集上的生成性能。G2PT 在 24 项评测指标中,有 11 项取得了第一,并在 17 项中排名前二。

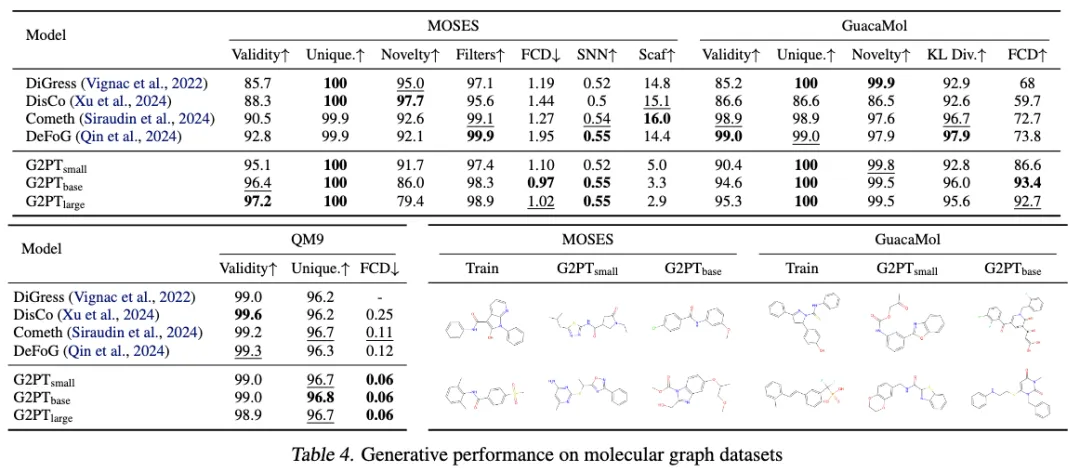

分子图生成性能

在 MOSES 和 GuacaMol 数据集上,G2PT 在生成有效性(Validity)、唯一性(Uniqueness)、和分子属性分布匹配等指标上表现优异。实验显示MOSES 数据集上,G2PT 达到 97.2% 有效性,领先同类方法。同时在 QM9 数据集上,G2PT 的生成分布和目标分布的匹配度(FCD)最低,显示了其生成质量的高度一致性。

模型和数据规模的影响

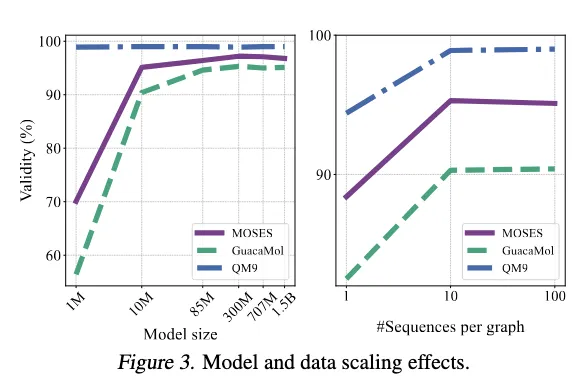

论文还详细分析了 G2PT 在模型和数据规模变化下的性能。

📈 结果总结(Figure 3):

实验表明随着模型规模的增加(从 10M 到 1.5B 参数),生成性能显著提升,并在一定规模后趋于饱和。(符合 neural scaling law 的基本规律)除此之外增加每个图的训练序列数量能够提升模型的训练效果,但多样性达到一定水平后,收益递减。

迈向更通用的图生成模型

尽管 G2PT 在多个任务中表现卓越,但其对生成顺序的敏感性表明,不同图域可能需要不同的顺序优化策略。未来的研究可以进一步探索通用、表达力更强的顺序设计。

G2PT 的提出不仅为图生成领域带来了新的方法,也为其他图相关任务的研究与应用奠定了坚实基础。

文章链接:https://arxiv.org/pdf/2501.01073